- Met de opkomst van de AI-chatbots gaat de aandacht vooral uit naar de hulp die ze kunnen bieden op het werk en in het dagelijks leven.

- Tegelijkertijd kunnen kwaadwillenden dezelfde technologie inzetten om effectiever te worden.

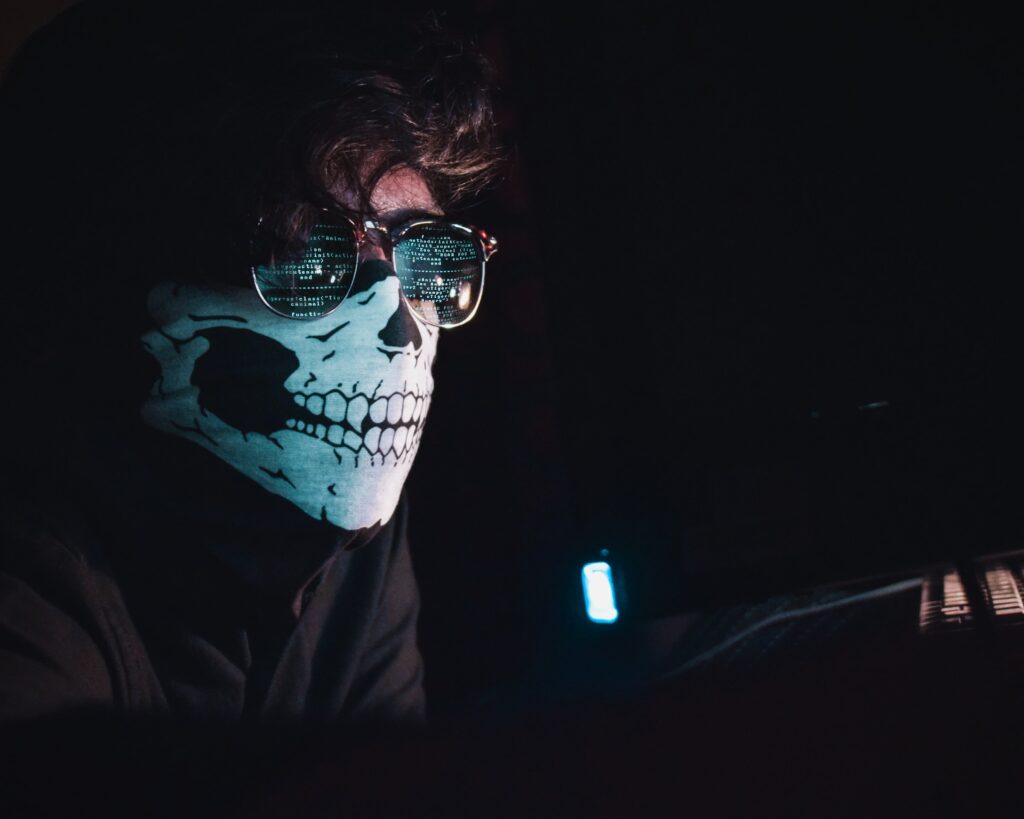

- Business Insider sprak met een cybersecurity expert over de manier waarop hackers kunstmatige intelligentie inzetten en wat de gevolgen ervan kunnen zijn.

- Lees ook: Miljoenen Samsung-telefoons, waaronder de Galaxy S22, zijn ongemerkt te hacken, volgens Google

De mogelijkheden van artificiële intelligentie (AI) hebben diepgaande invloed op de toekomst van werk, zo maken de ontwikkelingen rond de bot ChatGPT duidelijk. Kunstmatige intelligentie kan werkactiviteiten ondersteunen, maar dat geldt niet alleen in positieve zin. Ook cybercriminelen lezen mee en zien de potentie voor hun activiteiten groeien.

Zo zouden cybercriminelen kunstmatige intelligentie bijvoorbeeld kunnen inzetten voor eenvoudige en repetitieve taken, zodat ze zich ze kunnen richten op meer winstgevende zaken. De dames en heren van het digitale dievengilde zijn doorgaans redelijk technisch onderlegd en kunnen AI-tools handig inzetten om niet alleen bedrijven, maar ook personen zoals jij en ik het leven flink zuur te maken.

Een van de manieren waarop cybercriminelen ChatGPT en andere generatieve AI-software gebruiken, is voor het opstellen van phishing e-mails. Een correct geschreven e-mail die gericht is aan het slachtoffer met een gevaarlijke link erin, heeft immers veel meer kans van slagen dan een slecht vertaalde mail vol met spelfouten van een Prins die claimt veel geld voor je te hebben.

Aangezien phishing-aanvallen nog steeds het effectiefst zijn en daarom het meest gebruikt worden om privédata te stelen of een grotere cyberaanval op te zetten, is dit een zorgwekkende ontwikkeling. Gelukkig kunnen we onszelf blijven trainen om door AI geschreven teksten te herkennen en daarmee de kans op herkenning van phishingmails vergroten.

Cybercriminelen gebruiken artificial intelligence om betere programmeurs van malware te worden

Artificial intelligence maakt echter een potentieel nog gevaarlijkere ontwikkeling mogelijk. Een die niet alleen de drempel verlaagt om cybercrimineel te worden, maar die ook het niveau van digitale kruimeldieven flink kan opschroeven.

“Wat we nu zien gebeuren is dat cybercriminelen AI aan het gebruiken zijn om nieuwe malware te maken. Ze vragen chatbots om code te genereren met een speciaal doel, of om hun al bestaande code uit te breiden of aan te passen”, zegt Patrick de Jong, manager systems engineering voor Nederland van het Amerikaanse cybersecuritybedrijf Palo Alto Networks.

Technisch minder onderlegde criminelen met een idee kunnen de hulp van AI inschakelen om hun plan te concretiseren. Hoewel chatbots op dit moment nog niet altijd 100 procent werkende softwarecode kunnen schrijven, helpt een door kunstmatige intelligentie aangestuurde bot de crimineel wel op weg.

Anderzijds kan AI-software ook gebruikt worden om op het web gevonden broncodes af te maken, aan te passen of uit te breiden zonder dat hier enige kennis voor nodig is.

De Jong vertelt dat hij een programmeur kent die met een bepaalde broncode voor zijn software werkte en die geen zin had om een makkelijke interface te maken, omdat het te veel werk was. "Hij besloot hiervoor AI in te zetten om te zien wat het opleverde. Hij gaf de code aan de tool met als opdracht een interface te maken, wat resulteerde in een goed werkende user interface”, aldus De Jong. Daarmee werd de tool ineens veel bruikbaarder en was het ook ineens makkelijker te gebruiken door collega’s.

Dit voorbeeld kun je doorvertalen naar het criminele circuit. Mensen met minder goede bedoelingen zouden met AI hun malware gebruikersvriendelijker kunnen maken. Dat kan ervoor zorgen dat het vaker gebruikt wordt en dus leiden tot een mogelijke toename in het absolute aantal cyberaanvallen.

Dat laatste kan ook bewerkstelligd worden door artificial intelligence een broncode te laten genereren. Het maken van malware verandert dan van werk dat uren of dagen in beslag neemt, in een klusje van een paar minuten. “We verwachten dat cybercriminelen veel sneller een nieuwe tool zullen uitproberen en om te kijken of het werkt of niet”, zegt De Jong. “Helaas hebben we hier nog geen concrete cijfers van.”

Omdat de drempel voor het maken en inzetten van malware zoveel lager wordt, zal er steeds meer met hagel geschoten worden. Iets wat nu al veel wordt gedaan en waardoor soms bijvoorbeeld ziekenhuizen getroffen worden door ransomware. “Dat hoeft misschien niet eens het doel geweest te zijn van de crimineel. Maar als het daar toevallig werkt, wordt er toch wel op ingespeeld”, aldus De Jong.

Dit betekent mogelijk dat er in de toekomst nog massaler geschoten wordt op grotere bedrijven die in één klap voor een flinke buit kunnen zorgen. Ook kleinere bedrijven en privé-personen zullen een groter risico lopen om slachtoffer te worden van een cyberaanval.

Tegelijkertijd wordt door deze ontwikkeling de beveiliging tegen cyberaanvallen ook moeilijker. Een crimineel kan met behulp van AI veel vaker en sneller proberen wat werkt en wat niet. Dit zorgt voor een snellere innovatie en grotere diversiteit aan tools die cybercriminelen inzetten. En dat vertaalt zich naar meer druk op aanbieders van cybersecuritysoftware.

“We hebben daarbij een groot nadeel. Voor ons is experimenteren geen optie. De risico’s daarvan zouden te groot zijn”, zegt De Jong. “Maar we kunnen net zo goed als criminelen kunstmatige intelligentie inzetten om onszelf beter en sneller te verdedigen tegen nieuwe malware en cyberaanvallen.”

Voor cybersecurity biedt AI ook kansen om sneller in de tegenaanval te gaan

Een manier waarop cybersecuritybedrijven kunstmatige intelligentie inzetten, is voor snelle analyses van inkomende data en het automatiseren van bepaalde stappen.

“Als er bijvoorbeeld een phishingmail is binnengekomen bij een bedrijf, kan kunstmatige intelligentie in razend tempo de mail opsporen in andere mailboxen, bepalen of deze geopend is en wat de impact ervan is op het systeem. Daarop kan de AI-software acties ondernemen, bijvoorbeeld door een geïnfecteerd systeem in quarantaine te plaatsen, totdat iemand het probleem kan verhelpen met een nieuwe installatie”, legt De Jong Uit.

En dat is niet het enige. Met de opkomst van het ‘Internet of Things’ (IoT) - ofwel losse apparaten die thuis of op het werk met het internet zijn verbonden - wordt het steeds uitdagender om alle apparaten in een netwerk te monitoren en te beveiligen. “

AI kan hierin helpen met het in de gaten houden van de activiteit op het netwerk”, zegt De Jong. “Op basis van een dataset die is opgebouwd, kan AI-software bepalen of een IoT-apparaat zich vreemd gedraagt. Mocht dat het geval zijn, dan kunnen er snel maatregelen worden genomen”.

De Jong benadrukt dat het voor bedrijven en particulieren geen optie meer is om cybersecurity te laten sloffen. "De risico’s nemen alleen maar toe en de kans dat je slachtoffer wordt ook”, zegt hij stellig. “Het idee van 'ik ben niet interessant, dus ik ben geen doelwit', gaat ook niet meer op. Je zou bijvoorbeeld een opstapje kunnen zijn naar een bedrijf, zonder dat je er erg in hebt. Je moet je tegenwoordig overal op voorbereiden.”

Maar hoe kun je je dan het beste voorbereiden op deze gevaarlijke ontwikkeling, afgezien van een gedegen anti-virusprogramma? “Wellicht is het niet meer zo’n goed idee om met losse oplossingen van verschillende aanbieders te werken. Deze werken wel met elkaar, maar er kunnen hierdoor nog steeds dingen worden gemist. Daardoor kan je wellicht minder snel ingrijpen”, stelt De Jong.

Met de oplossingen van meerdere aanbieders beperk je volgens de De Jong ook nog eens de werking van de AI-software die aan jouw kant staat. “Je bent afhankelijk van de verwerkingssnelheid van de verschillende fabrikanten en je kunt er niet vanuit gaan dat dit op de snelheid gaat die je graag wilt. Als je met één aanbieder werkt, communiceert elk onderdeel direct met elkaar en hoef je dus nergens op te wachten”, legt hij uit.

Uiteindelijk komt het er dus op neer wie artificial intelligence het snelst en het meest effectief kan inzetten. Op dit moment heeft de digitale crimineel nog het voordeel dat hij meer vrijheid heeft in het gebruik van kunstmatige intelligentie. De effectiviteit van cyberaanvallen wordt echter ook steeds sneller beperkt, omdat de AI-software die aan de andere kant opereert, malware sneller herkent en er beter op kan inspelen.

De razendsnelle ontwikkeling van kunstmatige intelligentie betekent ook dat er meer verantwoording komt te liggen bij de makers van AI. Zij kunnen in de basis veel van de bruikbaarheid van hun AI-tools wegnemen voor criminelen en zo de risico’s voor bonafide computergebruikers beperken.